Has visto los titulares, pero la verdad sobre el algoritmo «life2vec» no es un oráculo del destino. Es el espejo de un futuro que ya está aquí.

Hola, soy Goslen Burgos, y hoy necesitamos hablar de un fantasma.

El Origen del Mito: ¿De Dónde Salió la «Calculadora de la Muerte»?

Un fantasma digital que ha recorrido el mundo a la velocidad de la luz. Se le conoce como la «calculadora de la muerte», una inteligencia artificial que, según los titulares, puede predecir el día de tu fallecimiento con una precisión escalofriante.

Quiero empezar siendo categórico: esa calculadora de la muerte que te dice la fecha exacta de tu caducidad… no existe. Es un fraude. Un mito.

Pero como en toda buena historia de fantasmas, lo que la gente cree haber visto se basa en algo real. Y esa realidad, un experimento científico nacido en Dinamarca, es infinitamente más interesante y, francamente, mucho más inquietante que cualquier oráculo del destino.

En los próximos minutos, vamos a demoler juntos este mito. Pero más importante aún, te revelaré qué es realmente el algoritmo life2vec. Y te prometo que al final, entenderás por qué el verdadero peligro no es que una IA prediga tu muerte, sino que prediga… todo lo demás.

¿Qué es Life2vec Realmente? La Ciencia de Tratar la Vida como un Lenguaje

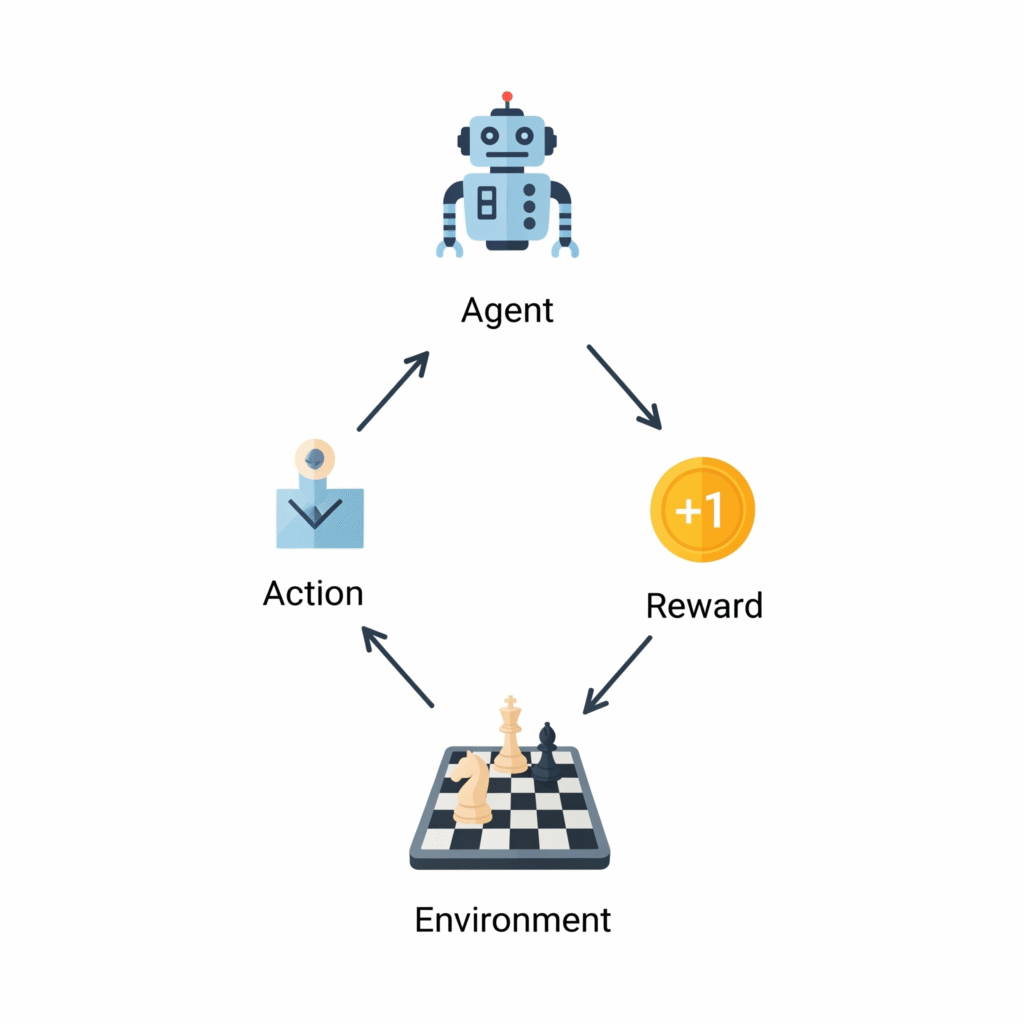

Para entender lo que crearon estos científicos daneses, primero debemos cambiar nuestra perspectiva. Olvida por un momento la biología o la estadística, y piensa en la vida como si fuera un idioma.

Imagina que cada evento significativo de tu existencia es una palabra en la gran novela de tu vida: «Naciste en 1985». «Fuiste a la escuela». «Te diagnosticaron gripe en 2009». «Cambiaste de trabajo en 2015». «Compraste una casa en 2021».

La brillantez del modelo life2vec fue tratar esa secuencia de eventos exactamente como los Grandes Modelos de Lenguaje (como ChatGPT) tratan a las frases. Utilizando los datos de salud y socioeconómicos de más de 6 millones de daneses, la IA no aprendió a «predecir el futuro», sino a entender la «gramática de la vida». Aprendió qué «palabras» suelen seguir a otras y qué secuencias de eventos tienden a llevar a ciertos desenlaces.

La Verdad sobre el Famoso «78% de Precisión»

Aquí es donde nació el mito. Los investigadores le plantearon al modelo una pregunta muy específica: «Observando la secuencia de vida de una persona hasta cierta edad, ¿cuál es la probabilidad de que fallezca en los próximos cuatro años?».

La respuesta fue que, en un escenario de prueba diseñado para ser muy difícil, el modelo acertó un 78% de las veces. Los medios de comunicación tomaron ese número, lo unieron al concepto más aterrador (la muerte) y crearon un titular irresistible.

Pero ese 78% esconde un matiz crucial. En el grupo de edad que estudiaban, la inmensa mayoría de la gente sobrevive. Un modelo tonto que siempre dijera «sobrevive» tendría una precisión altísima, pero no serviría de nada. Los investigadores probaron su IA en un conjunto de datos perfectamente equilibrado (50% de personas que vivieron, 50% que murieron) donde adivinar al azar solo te daría un 50% de aciertos. En ese difícil escenario, el 78% demostró que el modelo realmente había aprendido patrones significativos. No era una bola de cristal, sino una herramienta estadística excepcionalmente potente.

Pero, como en toda buena historia de suspense, la muerte solo era el cebo.

El Verdadero Poder (y Peligro) de Life2vec: Predecir la Vida

Aquí es donde la historia da un giro y se aleja de la parca para acercarse a nuestra vida cotidiana. Los investigadores usaron la muerte solo como una prueba de concepto. Pronto, le pidieron a life2vec que predijera otras cosas.

El Verdadero Poder (y Peligro) de Life2vec: Predecir la Vida

Y los resultados fueron asombrosos. Basándose solo en los datos de salud, trabajo e ingresos de una persona, el modelo podía predecir con alta precisión si se mudaría a otro país. Más inquietante aún, podía predecir sus respuestas en un test de personalidad estándar, determinando si alguien era propenso a ser extrovertido o introvertido.

De Predecir la Muerte a Predecir tu Personalidad

Piénsalo por un momento. Un algoritmo que, sin conocerte, puede deducir rasgos de tu personalidad a partir de tu historial vital. Y aquí, amigos míos, es donde encontramos el «algo peor» que les prometí.

Porque si una IA puede predecir tu personalidad… ¿quién más querría esa información?

El verdadero peligro de esta tecnología no es una «calculadora de muerte». Es una «calculadora de vida». Un sistema que puede ser usado por:

- Una compañía de seguros para determinar que, por tu historial, eres «propenso a tomar riesgos» y así subir tu prima o negarte la cobertura.

- Un banco para decidir que tu «secuencia de vida» te convierte en un mal candidato para una hipoteca.

- Un departamento de recursos humanos para filtrar tu currículum porque tu perfil no encaja con el «tipo de persona» que el algoritmo considera exitoso en su empresa.

El Riesgo Real: Un Sistema de Puntuación Social Invisible

El peligro no es un oráculo que te dice tu destino. Es un sistema invisible de puntuación social y comercial que activamente da forma a tu destino.

El Peligro de la Profecía Autocumplida Algorítmica

Así que aquí está la revelación final. El mito de la «calculadora de muerte» es una distracción, un chivo expiatorio que nos hace mirar hacia el lado equivocado.

El verdadero riesgo es que estos algoritmos creen una profecía autocumplida. Si un modelo le dice a un banco que eres un riesgo crediticio, el banco no te dará el préstamo. Sin ese préstamo, quizás no puedas invertir en tu negocio o tu educación. Y como resultado, tu situación financiera empeorará, cumpliendo así la predicción original del algoritmo.

La IA no habría predicho tu futuro; lo habría construido.

Así que no, life2vec no sabe cuándo vas a morir. Sabe algo mucho más íntimo y poderoso: sabe cómo funciona el sistema socioeconómico en el que vivimos. Y puede usar ese conocimiento para decidir si el sistema funciona para ti… o en tu contra.

Conclusión: La Pregunta Correcta que Debemos Hacernos sobre la IA

La pregunta que debemos hacernos ya no es si querríamos saber la fecha de nuestra muerte. La pregunta ahora es mucho más urgente: ¿estamos construyendo una sociedad donde un algoritmo decide el valor y el potencial de tu vida mientras todavía la estás viviendo?

Este debate no es ciencia ficción. Está sucediendo ahora, en las decisiones de crédito, en las contrataciones y en las pólizas de seguros. Y la única defensa que tenemos es entenderlo.

Quiero dejarles con una pregunta y leer sus respuestas en los comentarios. ¿Qué les da más miedo: una IA que predice su muerte o una IA que predice —y condiciona— su éxito en la vida?

Fuentes y Referencias

autogpt.netCan Machines Really Predict When You’ll Die? – AutoGPTSe abrirá en una ventana nuevaresearchgate.net(PDF) AI Death Calculator (Life2vec) – ResearchGateSe abrirá en una ventana nuevasorourbros.comAI Death Calculator: Is it Genuinely Accurate?Se abrirá en una ventana nuevacybernews.comAn AI model attempts to predict when you’ll die — here’s what happened when I tried itSe abrirá en una ventana nuevahsrc.himmelfarb.gwu.eduAI Death Calculator (Life2vec) – Health Sciences Research CommonsSe abrirá en una ventana nuevaanalyticsvidhya.comLife2vec AI Accurately Predicts the Future! – Analytics VidhyaSe abrirá en una ventana nuevahyscaler.comLife2vec: How AI Can Empower You to Predict Life Events from Data – HyScalerSe abrirá en una ventana nuevapmc.ncbi.nlm.nih.govEthical considerations in implementing AI for mortality prediction in the emergency department: Linking theory and practiceSe abrirá en una ventana nuevadtu.dkArtificial intelligence can predict events in people’s lives – DTUSe abrirá en una ventana nuevaeurekalert.orgArtificial intelligence can predict events in people’s lives – EurekAlert!Se abrirá en una ventana nueva4imag.comLife2Vec the AI model that predicts the date of death – 4imagSe abrirá en una ventana nuevaweam.aiThis AI Death Calculator Can Predict Your Death with 78% Accuracy – Weam AISe abrirá en una ventana nuevasodas.ku.dkProcessing a life like a language helps predict future personal eventsSe abrirá en una ventana nuevainsidetelecom.comLife2vec AI Model: The New Age Fortune Teller – Inside TelecomSe abrirá en una ventana nuevacdomagazine.techAI Death Calculator — New AI Model Can Predict Your Likelihood of Dying – CDO MagazineSe abrirá en una ventana nuevaoecd.aiLife2Vec AI predicts death date, sparks ethical and privacy debate …Se abrirá en una ventana nuevasciencealert.comThis New AI Predicts Your Life. Then It Predicts Your Death …Se abrirá en una ventana nuevaarxiv.orgUsing Sequences of Life-events to Predict Human LivesSe abrirá en una ventana nuevalife2vec.dklife2vec – Official Model and Publication SourceSe abrirá en una ventana nuevaconsorsegurosdigital.comImportance of computational modelling and risk forecasting in cardiovascular disease prevention to reduce morbidity, mortality, and health insurance claim rates – ConsorsegurosSe abrirá en una ventana nuevascor.comTHE IMPACT OF ARTIFICIAL INTELLIGENCE ON THE (RE)INSURANCE SECTOR – SCORSe abrirá en una ventana nuevanews.northeastern.eduA new AI model can predict human lifespan, researchers say. They want to make sure it’s used for goodSe abrirá en una ventana nuevahealth.ec.europa.euArtificial Intelligence in healthcare – European Commission – Public HealthSe abrirá en una ventana nuevasoa.orgThe Impact of Artificial Intelligence on Mortality Modeling and … – SOASe abrirá en una ventana nuevabmj.comFUTURE-AI: international consensus guideline for trustworthy and …Se abrirá en una ventana nuevatechtimes.comDoom Calculator: Death-Predicting AI Algorithm Sparks Ethical DebateSe abrirá en una ventana nuevaactuaries.orgEmbracing AI: Transforming the Actuarial ProfessionSe abrirá en una ventana nueva1000minds.comWhat is Human-in-the-loop (HITL) in AI-assisted decision-making? – 1000mindsSe abrirá en una ventana nuevadevoteam.comHuman-In-The-Loop: What, How and Why | DevoteamSe abrirá en una ventana nuevapaubox.comReal-world examples of healthcare AI bias – PauboxSe abrirá en una ventana nuevadeepscribe.aiOptimizing Human-AI Collaboration: A Guide to HITL, HOTL, and HIC SystemsSe abrirá en una ventana nuevaiguazio.comWhat is Human in the Loop – IguazioSe abrirá en una ventana nuevaarxiv.orgDetecting algorithmic bias in medical-AI models – arXivSe abrirá en una ventana nuevaresearchgate.netExplainable AI (XAI) in healthcare: Enhancing trust and transparency in critical decision-making – ResearchGateSe abrirá en una ventana nuevapmc.ncbi.nlm.nih.govSurvey of Explainable AI Techniques in Healthcare – PMCSe abrirá en una ventana nuevaselbyjennings.comThe Future of AI in Actuarial Science Services – Selby JenningsSe abrirá en una ventana nuevaviso.aiExplainable AI (XAI): The Complete Guide (2025) – Viso SuiteSe abrirá en una ventana nuevapmc.ncbi.nlm.nih.govArtificial Intelligence Bias in Health Care: Web-Based Survey – PMCSe abrirá en una ventana nuevapostgraduateeducation.hms.harvard.eduConfronting the Mirror: Reflecting on Our Biases Through AI in Health CareSe abrirá en una ventana nuevapmc.ncbi.nlm.nih.govGeneralizability of FDA-Approved AI-Enabled Medical Devices for Clinical Use – PMCSe abrirá en una ventana nuevaraps.orgStudy: Data lacking for AI-enabled medical devices cleared by FDA – RAPSSe abrirá en una ventana nuevanber.orgNBER WORKING PAPER SERIES THE POTENTIAL IMPACT OF ARTIFICIAL INTELLIGENCE ON HEALTHCARE SPENDING Nikhil Sahni George Stein RodneSe abrirá en una ventana nuevahoganlovells.comAI Health Law & Policy: FDA’s rapidly evolving regulatory paradigms – Hogan LovellsSe abrirá en una ventana nuevascholar.harvard.eduThe Economics of Artificial Intelligence: Health Care Challenges – Harvard UniversitySe abrirá en una ventana nuevafenwick.comFDA Issues Draft Guidances on AI in Medical Devices, Drug Development – FenwickSe abrirá en una ventana nuevahiig.deOne step forward, two steps back: Why Artificial Intelligence is currently mainly predicting the past – Alexander von Humboldt Institut für Internet und Gesellschaft | HIIGSe abrirá en una ventana nuevaneurosciencenews.comAI’s Leap in Predicting Life Events – Neuroscience NewsSe abrirá en una ventana nuevamichiganmedicine.orgWhat’s the impact of predictive AI in the health care setting? | Michigan MedicineSe abrirá en una ventana nuevapsychologytoday.comAI Predicts Human Life Events, Including Death | Psychology TodaySe abrirá en una ventana nuevapmc.ncbi.nlm.nih.govExplainable AI and transformer models: Unraveling the nutritional influences on Alzheimer’s disease mortality – PubMed CentralSe abrirá en una ventana nuevacapphysicians.comThe Role of Informed Consent in Medical AI: Balancing Innovative Advancements With Patient Rights | The Cooperative of American PhysiciansSe abrirá en una ventana nuevaquantamagazine.org’Next-Level’ Chaos Traces the True Limit of Predictability | Quanta MagazineSe abrirá en una ventana nuevapmc.ncbi.nlm.nih.govAI-driven healthcare: Fairness in AI healthcare: A survey – PMC – PubMed CentralSe abrirá en una ventana nuevainformationgovernanceservices.comAI Uses in Medical Care: Should They Be Disclosed to Patients? | IGSSe abrirá en una ventana nuevapmc.ncbi.nlm.nih.govPatient perspectives on informed consent for medical AI: A web-based experiment – PMCSe abrirá en una ventana nuevaresearchgate.netFair Machine Learning in Healthcare: A Review – ResearchGateSe abrirá en una ventana nuevaacademic.oup.comAlgorithmic individual fairness and healthcare: a scoping review – Oxford AcademicSe abrirá en una ventana nuevafrontiersin.orgEconomic implications of artificial intelligence-driven recommended systems in healthcare: a focus on neurological disorders – FrontiersSe abrirá en una ventana nuevalangkilde.seLimits of Prediction – LangkildeSe abrirá en una ventana nuevaarxiv.orgFairness-Aware Interpretable Modeling (FAIM) for Trustworthy Machine Learning in Healthcare – arXivSe abrirá en una ventana nuevatandfonline.comFull article: Beyond implementation: the long-term economic impact of AI in healthcareSe abrirá en una ventana nuevaresearchgate.net(PDF) Limits of Predictability in Human Mobility – ResearchGateSe abrirá en una ventana nuevapubmed.ncbi.nlm.nih.govLimits of predictability in human mobility – PubMedSe abrirá en una ventana nuevakeragon.comThe Economic Impact of AI in Healthcare: Key Considerations for 2025 and BeyondSe abrirá en una ventana nuevapnas.orgThe origins of unpredictability in life outcome prediction tasks – PNASSe abrirá en una ventana nuevadowntoearth.org.inWHO releases guidelines for multi-modal generative AI in healthcare, resonates with recommendations for other sectors – Down To EarthSe abrirá en una ventana nuevanews-medical.netWHO issues ethical guidelines for AI in healthcare, focusing on large multi-modal modelsSe abrirá en una ventana nuevawho.intWHO releases AI ethics and governance guidance for large multi-modal modelsSe abrirá en una ventana nuevanews.web.baylor.eduPeople Afraid of Robots Are Much More Likely to Fear Losing Their Jobs and Suffer Anxiety, Baylor Study Finds | Media and Public RelationsSe abrirá en una ventana nuevabipartisanpolicy.orgThe AI Revolution in Health Care: Five Key Developments Policymakers Should WatchSe abrirá en una ventana nuevadigitalcommons.lindenwood.eduThe Algorithm of Fear: Unpacking Prejudice Against AI and the Mistrust of Technology – Digital Commons@Lindenwood UniversitySe abrirá en una ventana nuevahsph.harvard.eduAlgorithmic Bias in Health Care Exacerbates Social Inequities—How to Prevent ItSe abrirá en una ventana nuevachicagobooth.eduAlgorithmic Bias Initiative – Center for Applied Artificial Intelligence | Chicago BoothSe abrirá en una ventana nuevatechpolicy.pressThe Right to Be Forgotten Is Dead: Data Lives Forever in AI | TechPolicy.PressSe abrirá en una ventana nuevamagazine.publichealth.jhu.eduRooting Out AI’s Biases | Hopkins Bloomberg Public Health MagazineSe abrirá en una ventana nuevamercer.comDigital twin technology: Game changer for personalized medicine – MercerSe abrirá en una ventana nuevaresearchgate.netWhat is There to Fear? Understanding Multi-Dimensional Fear of AI from a Technological Affordance Perspective | Request PDF – ResearchGateSe abrirá en una ventana nuevaexabeam.comThe Intersection of GDPR and AI and 6 Compliance Best Practices | ExabeamSe abrirá en una ventana nuevacloudsecurityalliance.orgThe Right to Be Forgotten — But Can AI Forget? | CSA – Cloud Security AllianceSe abrirá en una ventana nuevakarger.comDigital Twins: The Future of Personalized Nutrition and Health? – Karger PublishersSe abrirá en una ventana nuevanewzealand.aiDo AI platforms comply with the ‘Right to be forgotten’? — NewZealand.AISe abrirá en una ventana nuevaletslaw.esThe Right to be Forgotten in the Age of Artificial Intelligence – LetsLawSe abrirá en una ventana nuevasanogenetics.comPrecision at scale: The role of health digital twins in the future of medicine – Sano GeneticsSe abrirá en una ventana nuevamdpi.comDigital Twins: The New Frontier for Personalized Medicine? – MDPISe abrirá en una ventana nuevajmir.orgEnvisioning the Future of Personalized Medicine: Role and Realities of Digital TwinsSe abrirá en una ventana nuevaarxiv.orgAre We Truly Forgetting? A Critical Re-examination of Machine Unlearning Evaluation Protocols – arXivSe abrirá en una ventana nuevaarxiv.orgBridge the Gaps between Machine Unlearning and AI Regulation – arXivSe abrirá en una ventana nuevaarxiv.orgMachine Unlearning: Solutions and Challenges – arXivSe abrirá en una ventana nuevamdpi.comData-Driven Social Security Event Prediction: Principles, Methods, and Trends – MDPISe abrirá en una ventana nuevapmc.ncbi.nlm.nih.govAlgorithmic emergence? Epistemic in/justice in AI-directed transformations of healthcare – PMC – PubMed CentralSe abrirá en una ventana nuevaarxiv.orgEpistemic Injustice in Generative AI – arXivSe abrirá en una ventana nuevaarxiv.orgMachine Unlearning: Solutions and Challenges – arXivSe abrirá en una ventana nuevaaspendigital.orgAI Geopolitics Beyond the US-China Rivalry – Aspen DigitalSe abrirá en una ventana nuevaojs.aaai.orgContributory Injustice, Epistemic Calcification and the Use of AI Systems in Healthcare – AAAI PublicationsSe abrirá en una ventana nuevaphilpapers.orgA taxonomy of epistemic injustice in the context of AI and the case for generative hermeneutical erasure – PhilPapersSe abrirá en una ventana nuevamccormick.northwestern.eduNavigating the Geopolitical Stakes of Artificial Intelligence | NewsSe abrirá en una ventana nuevafpf.orgGeopolitical fragmentation, the AI race, and global data flows: the new realitySe abrirá en una ventana nuevausip.orgAI at a Geopolitical Crossroads: The Tension Between Acceleration and RegulationSe abrirá en una ventana nuevajme.bmj.comPractical, epistemic and normative implications of algorithmic bias in healthcare artificial intelligence: a qualitative study of multidisciplinary expert perspectives | Journal of Medical EthicsSe abrirá en una ventana nuevaahajournals.orgSocial Determinants of Health Improve Predictive Accuracy of Clinical Risk Models for Cardiovascular Hospitalization, Annual Cost, and Death | CirculationSe abrirá en una ventana nuevamedinform.jmir.orgIncluding Social and Behavioral Determinants in Predictive Models: Trends, Challenges, and Opportunities – JMIR Medical InformaticsSe abrirá en una ventana nuevaFuentes consultadas pero que no se usaron